Tương tự hàng loạt thiết bị không người lái có vũ trang được lập trình kiểu “súng đạn vô tình” hay các lá chắn tên lửa hoàn toàn tự động, công nghệ “robot sát thủ” cũng có thể được thiết kế để nhận dạng và loại bỏ các nghi phạm khủng bố ngay tại hiện trường.

“Robot sát thủ” đang đến gần

Trong một thời gian dài, những ý tưởng này tưởng chừng như chỉ có trong khoa học viễn tưởng, trong những bộ phim kiểu như loạt phim đình đám Kẻ hủy diệt của ngôi sao Arnold Schwarzenegger. Thế nhưng những cỗ máy sát thủ này là kết quả không quá bất ngờ sau nhiều thập niên các tập đoàn công nghệ quốc phòng cho phát triển vũ khí thông minh. Mặc dù việc triển khai các vũ khí này có thể còn mất nhiều thập niên để đưa vào thực chiến nhưng các nguyên bản của những thiết bị với khả năng tự đưa ra quyết định khi tác chiến như vậy đã được sản xuất.

Một ví dụ của loại hình nghiên cứu này là tên lửa chống hạm tầm xa (LRASM) của Tập đoàn quốc phòng Lockheed Martin, có khả năng bay hàng trăm cây số và tự động tránh radar đối phương. Tương tự, Văn phòng nghiên cứu hải quân (ONR) thuộc Bộ Quốc phòng Mỹ tháng 12-2016 cũng đã công bố một loại tàu không người lái, có khả năng tự xác định các tàu không rõ lai lịch là “bạn hay thù”. Bộ Quốc phòng Mỹ cũng đã cho thử nghiệm các thiết bị không người lái được trang bị công nghệ nhận diện gương mặt và, về lý thuyết, có thể xác định đâu là khủng bố rồi tự đưa ra quyết định tiêu diệt đối tượng.

Một kỷ nguyên mới của những cỗ máy đang được mở ra. Máy móc sẽ có khả năng được trao quyền quyết định giữa sự sống và cái chết. Các nghiên cứu về trí tuệ nhân tạo đang ngày càng đạt được những bước tiến mới. Và chính Tổng thống đắc cử Mỹ Donald Trump sẽ phải giải quyết câu hỏi liệu quân đội Mỹ sẽ theo đuổi loại công nghệ này hay để những nước khác vượt mặt và phát triển trước Mỹ.

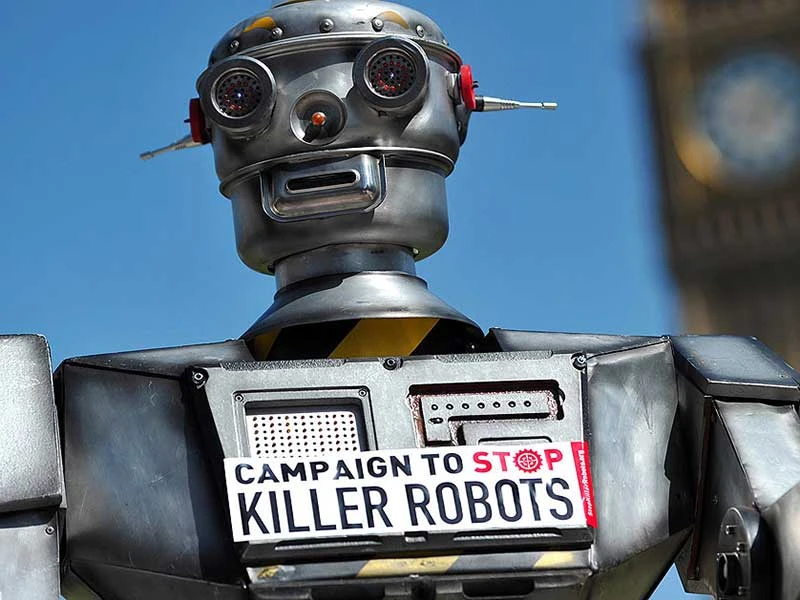

Một robot giả được đặt tại London trong chiến dịch phản đối chế tạo “robot giết người” vào tháng 4-2013. Ảnh: GETTY

Bài toán cho Donald Trump

Các nhóm nhân quyền lo ngại cảnh báo một “cuộc chạy đua robot vũ trang” có thể sẽ diễn ra. Theo họ, tương tự các máy bay điều khiển từ xa mà Mỹ đã triển khai tại các điểm nóng chính trị như Yemen và Afghanistan, làn sóng áp dụng những vũ khí tự hành này vào chiến tranh sẽ không thể bị ngăn cản một khi chúng được các nước sử dụng rộng rãi, đặc biệt là Mỹ - quốc gia xuất khẩu vũ khí lớn nhất năm 2016, theo đánh giá của Viện Nghiên cứu hòa bình quốc tế (SIPRI) tại Stockholm.

Trong một lá thư trình lên Ngoại trưởng Mỹ John Kerry và Bộ trưởng Quốc phòng Ashton Carter vào tháng 12 năm nay, có chín nghị sĩ đảng Dân chủ tại Hạ viện đã cảnh báo robot giết người “sẽ không chỉ đơn thuần là một loại vũ khí mới trong kho vũ khí của thế giới mà còn tạo ra một cách thức chiến tranh mới”. Các nghị sĩ này kêu gọi Mỹ ban hành một lệnh cấm “phủ đầu” để ngăn ngừa sự phát triển cũng như sử dụng loại công nghệ khó lường này.

Thế nhưng Steven Groves, thành viên mảng ngoại giao đội chuyển giao quyền lực của ông Trump, lại cho rằng Mỹ không nên phản đối lệnh cấm đối với các vũ khí này mà ngược lại còn phải đi đầu trong việc phát triển chúng: “Mỹ không nhất thiết phải chịu trách nhiệm trước bất kỳ nghị định thư nào tại Geneva nhằm cấm các vũ khí chúng ta đang phát triển. Tại sao Mỹ phải làm điều đó khi mà các đối thủ cạnh tranh của Mỹ đang nghiên cứu các loại vũ khí tương tự”. Trong một bài viết cho quỹ Heritage Foundation năm 2015, ông Groves nói rằng phát triển các vũ khí tự hành là “cách duy nhất để các lực lượng vũ trang Mỹ có thể duy trì lợi thế chiến thuật và chiến lược so với kẻ thù trong các cuộc xung đột trong tương lai”.

Cho đến nay chính quyền ông Obama vẫn giữ lập trường trung lập về vấn đề này. Tuy nhiên, Nhà Trắng hiện đã tiến hành rà soát các vấn đề về pháp lý và đạo đức liên quan tới trí tuệ nhân tạo dùng trong quân sự. Tuy nhiên, theo trang Politico, những nghiên cứu này vẫn sẽ không thể hoàn thành trước ngày nhậm chức tổng thống của ông Trump. Vào năm 2012, Lầu Năm Góc cũng đã ra chỉ thị hạn chế sử dụng “vũ khí bán tự hành”, loại vũ khí vẫn cần con người ra quyết định cuối cùng, để thực hiện các nhiệm vụ tác chiến. Tuy nhiên, chỉ thị của Lầu Năm Góc vẫn cho phép nghiên cứu và phát triển các vũ khí hoàn toàn tự hành với điều kiện được sự cho phép từ Bộ tổng tham mưu liên quân Mỹ.

Ngoài ra, lệnh cấm triển khai vũ khí tự hành của Bộ Quốc phòng Mỹ cũng chỉ có giới hạn trong vòng năm năm. Điều đó đồng nghĩa với việc chính quyền ông Trump trong năm 2017 sẽ có cơ hội đưa ra các chính sách mới liên quan tới nghiên cứu trí tuệ nhân tạo trong quân sự. Đối với giới chuyên gia, các chính sách như vậy sẽ giúp phác họa cụ thể đâu là ranh giới những vấn đề được và không được chấp thuận trong việc phát triển và cả áp dụng trên chiến trường loại công nghệ khó lường này.

“Chính quyền kế nhiệm phải sớm quyết định khi nào và nơi đâu họ sẽ triển khai những hệ thống này để chúng có thể phù hợp với các luật về chiến tranh” - bà Heather Roff, chuyên gia an ninh mạng đến từ tổ chức phân tích chính sách công New America tại Washington, D.C. cho biết.

Câu hỏi Donald Trump sẽ ra chính sách gì với “robot giết người” trên đất Mỹ vẫn còn bỏ ngỏ. Ảnh: GETTY

Ảnh một robot có vũ trang tiên tiến MARS đuợc chụp tại Bộ Quốc phòng Mỹ vào ngày 14-5-2015. Ảnh: GETTY

Tranh luận đúng sai về tương lai thế giới

Cũng như cuộc tranh luận trong thế kỷ 20 về việc phát triển vũ khí nguyên tử, những người ủng hộ công nghệ robot sát thủ tranh luận rằng loại công nghệ này có thể giúp hạn chế thương vong. Một số nhà hoạch định quân sự hy vọng các robot sát thủ có thể cho phép triển khai thực hiện nhiều nhiệm vụ phức tạp và nguy hiểm hơn mà không làm tổn hại đến tính mạng và sức khỏe của quân nhân.

Trong khi đó, những người phản đối cho rằng bằng cách giảm bớt những rủi ro trong chiến đấu, vũ khí tự hành sẽ gỡ bỏ đi nhiều ràng buộc và cân nhắc thiệt hại của các quốc gia trong việc phát động chiến tranh, khiến xung đột vũ trang dễ xảy ra hơn. Theo họ, các cỗ máy này cũng sẽ thiếu khả năng đưa ra phán quyết của con người, đánh mất đi các yếu tố nhân đạo. Tổ chức Ân xá Quốc tế (AI) lập luận những robot tự hành này sẽ “không thể không tuân lệnh”, không giống các binh sĩ Ai Cập đã từ chối bắn vào người biểu tình trong làn sóng cách mạng “Mùa xuân Ả Rập” bắt đầu hồi năm 2010.

Cùng với đó là hàng loạt câu hỏi nằm tại trung tâm cuộc tranh luận: Ai chịu trách nhiệm một khi vũ khí robot gây thương vong dân sự? Điều gì xảy ra nếu một lỗi lập trình gây nên sự cố “quân ta bắn quân mình”? Làm thế nào chính phủ có thể đảm bảo rằng các vũ khí tự hành tôn trọng nhân quyền và luật chiến tranh?

Jamie Metzl, thành viên cao cấp về công nghệ và an ninh quốc gia tại Hội đồng Đại Tây Dương, tổ chức chuyên phân tích về quan hệ quốc tế có trụ sở tại Washington, D.C. cảnh báo cuộc tranh luận về robot có khả năng giết người sẽ có tác động to lớn đối với tương lai thế giới. Ông cho rằng các quốc gia cần phải cẩn trọng: “Nhân loại sẽ phải cực kỳ thận trọng về các robot tự hành có vũ trang. Chúng sẽ không cần xin phép cho tất cả những gì chúng muốn làm”.

| Một hội nghị về vũ khí của LHQ tại Geneva trong tháng 12-2016 cũng bàn về vấn đề robot sát thủ nhưng vẫn chưa kêu gọi quốc tế đưa ra bất kỳ lệnh cấm nào. Tại hội nghị, các quốc gia, trong đó có Mỹ và Trung Quốc đã nhất trí lập ra một nhóm chuyên gia để nghiên cứu, bất chấp sự phản đối từ Nga. Nhóm sẽ phân tích, xem xét các giá trị mà công nghệ này đem lại cho lĩnh vực quân sự, các rủi ro và các vấn đề nhân đạo. Chuyên gia Roff đến từ tổ chức phân tích chính sách công New America (Mỹ) cho biết chính quyền ông Trump khiến bà nghi ngờ liệu Mỹ sẽ đẩy mạnh các tiến triển này tại LHQ hay không, đặc biệt với thái độ khá thân thiện mà ông Trump dành cho Tổng thống Nga Putin. |